Prolog:

„KI könnte die tiefgreifendste Technologie sein, die die Menschheit je entwickelt hat. Tiefgreifender als die Entdeckung des Feuers, der Elektrizität oder irgendetwas, das wir in der Vergangenheit getan haben.”

Sundar Pichai (* 10. Juni 1972 in Madurai, Indien) ist CEO von Google sowie dessen Holding Alphabet Inc.

Die Rolle von KI in der Compliance verstehen

Die Künstliche Intelligenz (KI) hat sich in einer Ära, in der der technologische Fortschritt die Industrien revolutioniert, zu einem wesentlichen Bestandteil der Compliance entwickelt. Die KI ist aufgrund ihrer Fähigkeit, umfangreiche Datenmengen zu analysieren und Muster zu identifizieren, ein unverzichtbares Instrument für Unternehmen, die gesetzliche Regelungen befolgen müssen.

KI in der Einhaltung gesetzlicher Vorschriften

Für jedes Unternehmen ist es äußerst wichtig, dass gesetzliche Vorschriften eingehalten werden und sich auf dem aktuellen Stand befinden. Dies umfasst die strikte Befolgung von Gesetzen, Vorschriften und Spezifikationen, die für geschäftliche Abläufe von Bedeutung sind.

Durch die Automatisierung der Prozesse der Überwachung und Berichterstattung macht KI diese Aufgabe deutlich einfacher. Um neue Anforderungen oder Aktualisierungen zu erkennen und die Einhaltung regulatorischer Anforderungen zu verwalten, kann sie große Mengen regulatorischer Inhalte schnell verarbeiten. KI-Systeme lassen sich so entwickeln, dass sie mit den aktuellen gesetzlichen Veränderungen Schritt halten und Unternehmen dabei unterstützen, die Vorschriften einzuhalten und auf Veränderungen oder Aktualisierungen schnell zu reagieren.

Maschinelles Lernen für Compliance

Maschinelles Lernen, ein Teilbereich der KI, ist dadurch gekennzeichnet, dass es Muster und Anomalien erkennt, die für die Einhaltung von Regeln von entscheidender Bedeutung sind. Um mögliche Compliance-Risiken zu prognostizieren und somit ein proaktives Risikomanagement zu ermöglichen, ist es möglich, zurückliegende und gleichzeitig aktuelle Daten auszuwerten, zu verknüpfen und miteinander in eine Beziehung zu setzen. Auf diese Weise können Algorithmen der KI und des maschinellen Lernens ihre Präzision bei der Identifizierung von Compliance-Problemen stetig erhöhen.

KI-Tools für Compliance-Beauftragte

Compliance-Mitarbeiter können ihre Effizienz durch die Automatisierung von alltäglichen Aufgaben wie der Datenanalyse mithilfe von KI-Tools erhöhen und Zeit für andere Aufgaben im Unternehmen sparen. KI-gesteuerte Analysen ermöglichen Einsichten in Risiken, steigern die Präzision von Berichten und reduzieren die Notwendigkeit von Ressourcen, die so für andere Tätigkeiten im Unternehmen genutzt werden können.

KI und Risikomanagement in der Compliance

KI hat beim Risikomanagement im Umfeld der Compliance eine wesentliche Bedeutung. Sie kann mögliche, potenzielle Compliance-Risiken prognostizieren und Maßnahmen zur Verringerung dieser vorschlagen. KI-Systeme sind in der Lage, Transaktionen in Echtzeit zu überwachen und vor potenziellen Betrugs- oder Compliance-Verstößen zu warnen. Die Echtzeitanalyse unterstützt dabei den Compliance-Beauftragten, Entscheidungen schnell zu treffen, um Compliance-Verstöße zu vermeiden.

Implementierung von KI in Compliance-Prozesse

Die Einbindung von Künstlicher Intelligenz (KI) in Compliance-Prozesse führt zu einer grundlegenden Veränderung der Herangehensweise von Unternehmen an die Einhaltung von Regeln. Die fortgeschrittenen KI-Algorithmen und Datenverarbeitungsfunktionen eröffnen unvorstellbare Chancen, um Compliance-Aufgaben zu optimieren und zu vereinfachen.

KI-Anwendungsfälle bei Compliance-Aktivitäten

Die Anwendungsmöglichkeiten von KI sind vielfältig. Sie kann zur Vorhersage potenzieller Compliance-Risiken verwendet werden, die auf historischen Daten beruhen. KI trägt auch zur Dokumentenanalyse bei, indem sie ausführliche rechtliche und regulatorische Unterlagen rasch durchsucht und auslegt, um sicherzustellen, dass Vorschriften eingehalten werden.

Außerdem ist es möglich, dass KI-gesteuerte Chatbots interaktive und maßgeschneiderte Lernerfahrungen zur Unterstützung von Compliance-Trainings für Mitarbeiter im Unternehmen bereitstellen.

Nutzung von KI zur Einhaltung von AML-Vorschriften

Die Befolgung der Anti-Geldwäsche-Vorschriften (AML) ist für Finanzinstitute, aber auch für andere Unternehmen aus unterschiedlichen Branchen, von großer Bedeutung. KI leistet einen bedeutenden Beitrag zu den Bestrebungen der AML, da sie moderne Instrumente zur Überwachung von Transaktionen, zur Identifizierung verdächtiger Aktivitäten, zur Verringerung von Fehlalarmen und zur Durchführung von Sorgfaltsprüfungen zur Verfügung stellt.

KI-Systeme sind in der Lage, Muster und Trends in Finanztransaktionen zu untersuchen, um mögliche Geldwäscheaktivitäten zu identifizieren. Dadurch können sie dazu beitragen, Finanzkriminalität frühzeitig aufzudecken und zu verhindern.

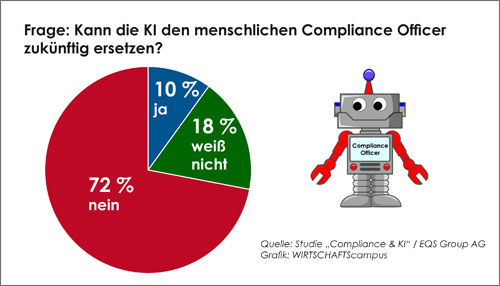

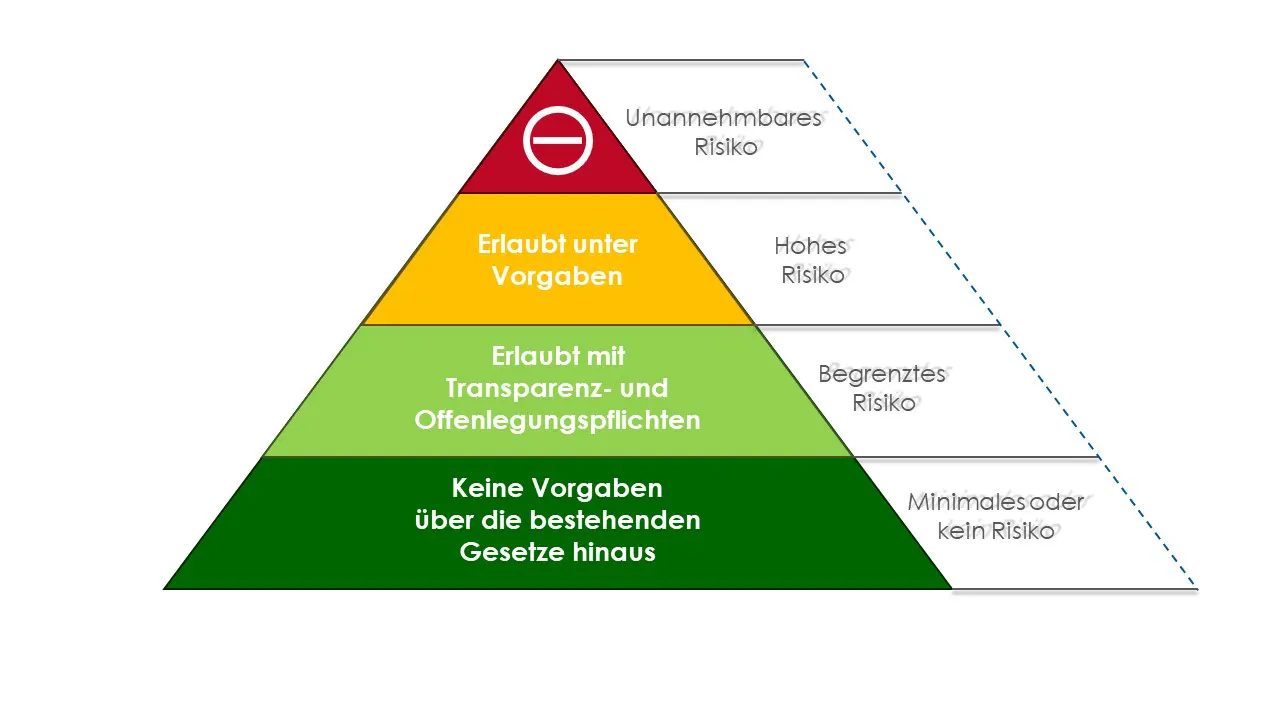

Wann tritt der EU AI Act in Kraft?

Die EU-Staaten haben den EU AI Act am 13.06.2024 verabschiedet und die Verordnung ist seit dem 01.08.2024 in Kraft. Grundsätzlich findet sie erst nach einer Übergangszeit von 24 Monaten – voraussichtlich August 2026 – Anwendung. Die KI-Verordnung verfolgt einen risikobasierten Ansatz, der KI-Systeme ausgehend von ihrem Risiko für die Sicherheit, Gesundheit und Grundrechte von Menschen bewertet. Die Verordnung differenziert im Grundsatz zwischen vier Risikostufen, an die unterschiedlich intensive Compliance-Anforderungen gestellt werden.

Die vier Risikostufen des EU AI Act

Grafik: WIRTSCHAFTScampus

Grafik: WIRTSCHAFTScampus

Beispiel für Unannehmbares Risiko:

Echtzeit Fernidentifizierung durch KI (weitere Beispiele folgen)

Beispiel für Hohes Risiko:

Prüfung der Kreditwürdigkeit durch KI (weitere Beispiele folgen)

Beispiel für Begrenztes Risiko:

Chatbots, KI-generierte Videos

Beispiel für Minimales Risiko:

Spamfilter, KI in Videospielen

Der nachfolgende Text und die Erklärungen beziehen sich auf die Veröffentlichung „KI-Gesetz: erste Regulierung der künstlichen Intelligenz“ des Europäischen Parlamentes aus 2023/2024. Die ausführliche Quellenangabe folgt am Schluss.

Was das Parlament von der KI-Gesetzgebung erwartet

Das Europäische Parlament will vor allem sicherstellen, dass die in der EU eingesetzten KI-Systeme sicher, transparent, nachvollziehbar, nicht diskriminierend und umweltfreundlich sind. KI-Systeme sollten von Menschen und nicht von der Automatisierung überwacht werden, um schädliche Ergebnisse zu verhindern. Das Parlament möchte außerdem eine technologieneutrale, einheitliche Definition für KI festlegen, die auf zukünftige KI-Systeme angewendet werden könnte.

Gesetz über künstliche Intelligenz: ein risikobasierter Ansatz

Die neuen Vorschriften legen Verpflichtungen für Anbieter und Nutzer fest, die sich nach dem Risiko, das von dem KI-System ausgeht, richten. Obwohl viele KI-Systeme ein minimales Risiko darstellen, müssen sie bewertet werden.

Unannehmbares Risiko

KI-Systeme stellen ein unannehmbares Risiko dar, wenn sie als Bedrohung für Menschen gelten. Diese KI-Systeme werden verboten. Sie umfassen:

- kognitive Verhaltensmanipulation von Personen oder bestimmten gefährdeten Gruppen, zum Beispiel sprachgesteuertes Spielzeug, das gefährliches Verhalten bei Kindern fördert;

- Soziales Scoring: Klassifizierung von Menschen auf der Grundlage von Verhalten, sozioökonomischem Status und persönlichen Merkmalen;

- biometrische Identifizierung und Kategorisierung natürlicher Personen;

- biometrische Echtzeit-Fernidentifizierungssysteme, zum Beispiel Gesichtserkennung.

Einige Ausnahmen können für Strafverfolgungszwecke zugelassen werden. Biometrische Echtzeit-Fernidentifizierungssysteme werden in einer begrenzten Anzahl schwerwiegender Fälle zulässig sein. Systeme zur nachträglichen biometrischen Fernidentifizierung, bei denen die Identifizierung erst mit erheblicher Verzögerung erfolgt, können zur Verfolgung schwerer Straftaten und nur nach gerichtlicher Genehmigung zulässig sein.

Hochrisiko-KI-Systeme

KI-Systeme, die ein hohes Risiko für die Gesundheit und Sicherheit oder für die Grundrechte natürlicher Personen darstellen, gelten als hochriskant und werden in zwei Hauptkategorien eingeteilt.

1. KI-Systeme, die in Produkten verwendet werden, die unter die Produktsicherheitsvorschriften der EU fallen. Dazu gehören Spielzeug, Luftfahrt, Fahrzeuge, medizinische Geräte und Aufzüge.

2. KI-Systeme, die in spezifische Bereiche fallen, und die in einer EU-Datenbank registriert werden müssen:

- Verwaltung und Betrieb von kritischen Infrastrukturen;

- allgemeine und berufliche Bildung;

- Beschäftigung, Verwaltung der Arbeitnehmer und Zugang zur Selbstständigkeit;

- Zugang zu und Inanspruchnahme von wesentlichen privaten und öffentlichen Diensten und Leistungen;

- Strafverfolgung;

- Verwaltung von Migration, Asyl und Grenzkontrollen;

- Unterstützung bei der Auslegung und Anwendung von Gesetzen.

Alle KI-Systeme mit hohem Risiko werden vor dem Inverkehrbringen und während ihres gesamten Lebenszyklus bewertet. Die Bürger werden das Recht haben, bei den zuständigen nationalen Behörden Beschwerden über KI-Systeme einzureichen.

Transparenzanforderungen

Generative Foundation-Modelle wie ChatGPT werden nicht als risikoreich eingestuft, müssen aber Transparenzanforderungen und das EU-Urheberrecht erfüllen:

- Offenlegung, dass der Inhalt durch KI generiert wurde;

- Gestaltung des Modells, um zu verhindern, dass es illegale Inhalte erzeugt;

- Veröffentlichung von Zusammenfassungen urheberrechtlich geschützter Daten, die für das Training verwendet wurden.

KI-Systeme mit allgemeinem Verwendungszweck und beträchtlichen Auswirkungen, die ein Systemrisiko darstellen könnten, wie das fortgeschrittene KI-Modell GPT-4, müssten gründlich bewertet werden und alle schwerwiegenden Vorfälle wären der Kommission zu melden.

Inhalte, die mit Hilfe von KI erzeugt oder verändert wurden – Bilder, Audio- oder Videodateien (z. B. Deepfakes) –, müssen eindeutig als KI-generiert gekennzeichnet werden, damit die Nutzer wissen, wenn sie auf solche Inhalte stoßen.

Nächste Schritte

Das Parlament verabschiedete das Gesetz über künstliche Intelligenz im März 2024 und der Rat erteilte seine Zustimmung im Mai 2024. Das Gesetz wird 24 Monate nach seinem Inkrafttreten in vollem Umfang anwendbar sein. Einige Teile werden jedoch schon früher anwendbar sein:

- das Verbot von KI-Systemen, die unannehmbare Risiken darstellen, wird sechs Monate nach Inkrafttreten gelten;

- die Verhaltenskodizes werden neun Monate nach Inkrafttreten gelten;

- Vorschriften für KI-Systeme mit allgemeinem Verwendungszweck, die den Transparenzanforderungen genügen müssen, gelten zwölf Monate nach Inkrafttreten.

Systeme mit hohem Risiko werden mehr Zeit haben, um die Anforderungen zu erfüllen; die sie betreffenden Verpflichtungen werden 36 Monate nach dem Inkrafttreten gelten.

„© Europäische Union, 2024 – Quelle: Europäisches Parlament“ – KI-Gesetz: erste Regulierung der künstlichen Intelligenz – Veröffentlichung des Europäischen Parlamentes / 19.06.2024

Die Bedeutung und Schwierigkeit der Rolle der Künstlichen Intelligenz (KI) bei der Einhaltung von Vorschriften nimmt mit der Entwicklung von Unternehmen und dem regulatorischen Umfeld zu. Eine stärker integrierte, intelligente und proaktive Herangehensweise wird in der Zukunft der KI in der Compliance deutlich.

Prädiktives Compliance-Management

Es ist unwahrscheinlich, dass die Zukunft der KI in der Compliance von ihren Fähigkeiten zur Vorhersage bestimmt wird. Nicht nur, dass KI-Systeme vorhandene Compliance-Probleme identifizieren, sondern auch künftige Gefahren prognostizieren. Unternehmen können durch diese Umstellung von einem reaktiven auf ein proaktives Compliance-Management vor rechtlichen und finanziellen Schwierigkeiten geschützt werden.

Compliance-Überwachung in Echtzeit

Mit dem Fortschritt der KI wird es immer wichtiger, die Einhaltung von Vorschriften in Echtzeit zu überwachen. Um sicherzustellen, dass gesetzliche Vorschriften eingehalten werden, werden KI-Systeme fortlaufend Transaktionen, Kommunikation und andere Geschäftsaktivitäten analysieren. Diese Echtzeitanalyse erlaubt eine unmittelbare Reaktion auf mögliche Verstöße gegen die Compliance.

Personalisierte Compliance-Lösungen

Von KI wird erwartet, dass sie maßgeschneiderte Compliance-Lösungen bereitstellt, die den individuellen Anforderungen jedes Unternehmens entsprechen. Das individuelle Risikoprofil und die Compliance-Historie eines Unternehmens werden von der KI analysiert, um individuelle Empfehlungen und Strategien für das Compliance-Management zu entwickeln.

Verbesserte regulatorische Intelligenz

Durch die automatische Sammlung und Verarbeitung von regulatorischen Informationen aus verschiedenen Quellen wird KI eine wichtige Funktion in der regulatorischen Intelligenz übernehmen. Dazu zählt es, die gegenwärtigen Regeln zu verstehen, künftige Trends und Veränderungen in den Regeln vorherzusagen und Unternehmen im Voraus vorzubereiten.

Umgang mit ethischen und datenschutzrechtlichen Bedenken

Eine Priorität wird es sein, ethische und datenschutzrechtliche Bedenken zu berücksichtigen, da KI immer mehr in die Compliance integriert wird. Um sicherzustellen, dass KI in der Compliance ethisch angewendet werden kann, müssen zukünftige Entwicklungen darauf abzielen, KI-Systeme zu entwickeln, die transparent, fair und datenschutzkonform sind.

Die Rolle der Compliance-Fachleute entwickelt sich weiter

Gerade auch im Hinblick auf die kommenden Anforderungen durch den EU AI Act ist die Weiterbildung im Bereich Compliance sowohl für den Chief Compliance Officer, den Compliance Officer aber auch für alle Mitarbeiter im Segment Compliance unausweichlich und dringend erforderlich. Sie werden nicht ersetzt, sondern kooperieren mit KI, wobei ihr Fokus auf den Bereichen Compliance-Strategie, Interpretation und Entscheidungsfindung liegt. KI wird die Kompetenzen des Compliance-Beauftragten und Compliance-Spezialisten ausbauen und nicht ihre Bedeutung verringern. Hier stehen die Compliance-Weiterbildung und Spezialisierung an erster Stelle.

Compliance-Weiterbildung: Jetzt starten!

Der WIRTSCHAFTScampus unterstützt Sie beim Erwerb der notwendigen Fachkunde in Compliance und Betreuung von Meldesystemen mit seinen Weiterbildungsangeboten:

Certified Compliance Officer

Certified Chief Compliance Officer

Compliance-Spezialisierungen:

Certified ESG Compliance Officer

Certified Export Compliance Officer

Certified Tax Compliance Officer

Certified IT Compliance Officer

Ausblick

In einem zweiten Teil dieses Blogbeitrags werden wir intensiver und detaillierter auf den EU AI Act im Hinblick auf Compliance- Fragen und neue Anforderungen eingehen.

In jedem Unternehmen, gleich welcher Branche und Größe, wird die Menge der Daten, die täglich verarbeitet werden müssen, immer größer. Was früher Tage und bis zu Wochen und Monate dauern konnte, erledigt heute die KI in Sekunden.

In jedem Unternehmen, gleich welcher Branche und Größe, wird die Menge der Daten, die täglich verarbeitet werden müssen, immer größer. Was früher Tage und bis zu Wochen und Monate dauern konnte, erledigt heute die KI in Sekunden.